Web scraping指通过自动化程序(如Python脚本)从网站提取数据的技术,用于市场调研、数据挖掘、价格比较等场景。其核心目标是将非结构化网页数据转换为结构化格式(如CSV、数据库)。

网页抓取使开发者能够从互联网上收集大量有价值的信息,为数据分析和决策提供基础。

使用库(如

通过解析库(如

将结果保存至CSV、数据库等。

此代码展示了如何从Python官方文档中提取函数名并保存到CSV文件中。注意我们使用了适当的延时和用户代理来避免被网站阻止。

抓取产品价格(如Flipkart),比较竞争对手。

通过定期抓取竞争对手的价格,企业可以制定更有竞争力的定价策略。

采集新闻/RSS源(

媒体公司可以使用网页抓取技术来整合多个信息源,创建个性化的内容平台。

批量获取论文数据(如PubMed)。

研究人员可以使用网页抓取从学术数据库中提取相关文献,加速研究进程。

收集社交媒体数据,分析用户情感和趋势。

企业可以通过分析社交媒体上的提及和评论,了解品牌声誉和市场趋势。

遵守目标网站条款,避免侵犯隐私或触犯法律。

商业用途建议咨询法律意见,确保您的网页抓取活动符合当地法律法规和网站的服务条款。

核心概念与流程

定义与目的

基本工作流程

发送HTTP请求

requests)获取网页HTML内容。

解析HTML

BeautifulSoup)提取目标数据。

数据存储

关键工具与库

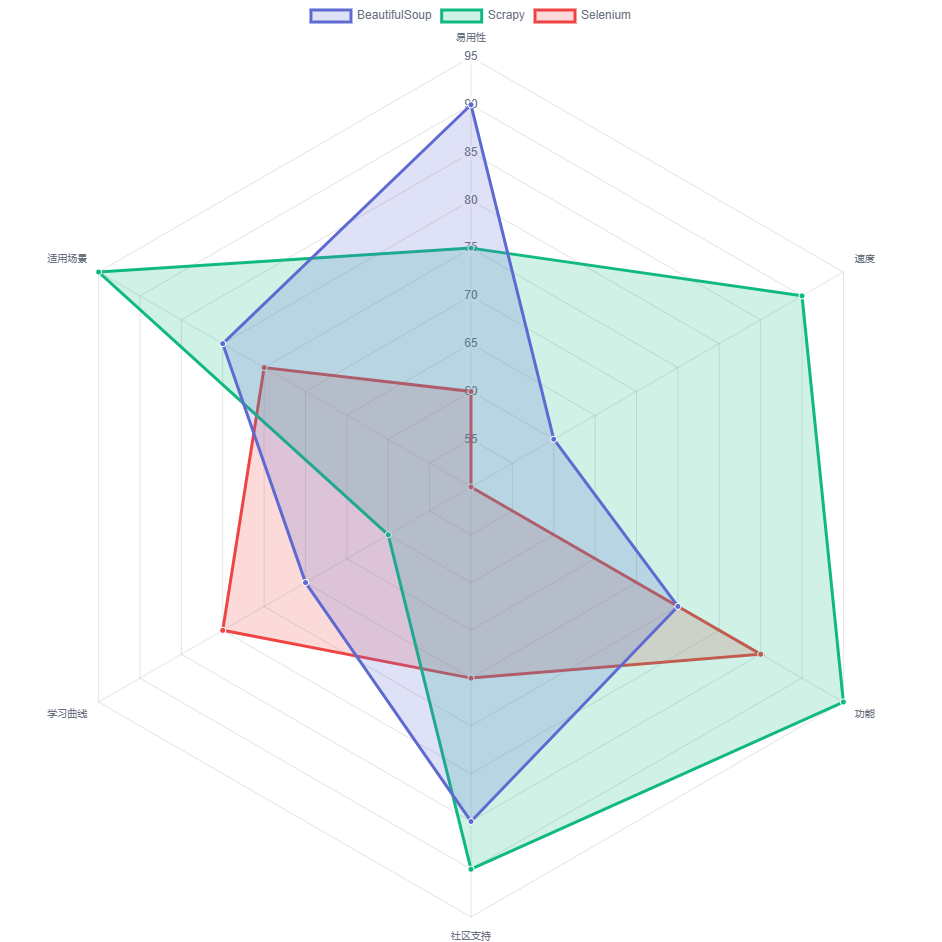

工具

用途

示例

BeautifulSoup

解析HTML/XML,支持标签查找(

find()/find_all())

soup.find('span', class_='green')

Scrapy

完整爬虫框架,适合大规模抓取

用于复杂项目(如电商数据采集)

Selenium

处理动态网页(JavaScript渲染)

模拟浏览器操作(如翻页、点击)

Requests

发送HTTP请求

requests.get(url).text

实践注意事项

合法性

robots.txt确认是否允许抓取time.sleep(2))

数据清洗

re库)或字符串处理清理提取内容clean_data = data.text.strip()

反爬虫应对

完整代码示例

# 1. 获取网页

import requests

from bs4 import BeautifulSoup

import csv

url = 'https://docs.python.org/3/library/random.html'

response = requests.get(url)

# 2. 解析并提取数据

soup = BeautifulSoup(response.text, 'html.parser')

functions = []

for item in soup.find_all('dt', class_='sig sig-object'):

func_name = item.get_text().strip()

functions.append(func_name)

# 3. 存储至CSV

with open('python_functions.csv', 'w', newline='') as f:

writer = csv.writer(f)

writer.writerow(['Function Name'])

writer.writerows([[func] for func in functions])

典型应用场景

电商价格监控

内容聚合

feedparser库)。

学术研究

市场分析

重要提醒

使用Python进行网页数据提取技术,Python网页抓取指南

作者:zvvq博客网

1

2

3

免责声明:本文来源于网络,如有侵权请联系我们!